![]() 发布时间:2024-02-28

发布时间:2024-02-28![]() 作者:光明实验室

作者:光明实验室![]() 浏览:5988次

浏览:5988次

城市三维创新团队的研究工作:基于文生图扩散模型的情感图像内容生成已发表在计算机视觉顶级会议 CVPR 2024上。

城市三维创新团队的研究工作EmoGen: Emotional Image Content Generation with Text-to-image Diffusion Models(基于文生图扩散模型的情感图像内容生成)已发表在计算机视觉顶级会议IEEE/CVF Computer Vision and Pattern Recognition Conference (CVPR) 2024上。

现有方法在具体概念的文生图上已经取得了不错的成效,然而尚不能很好地处理抽象概念。那么,机器能否创造出触动人心的图像呢?

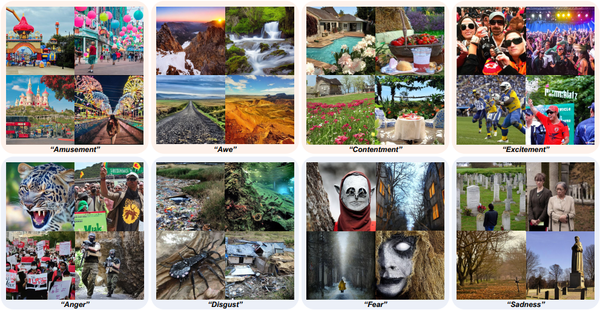

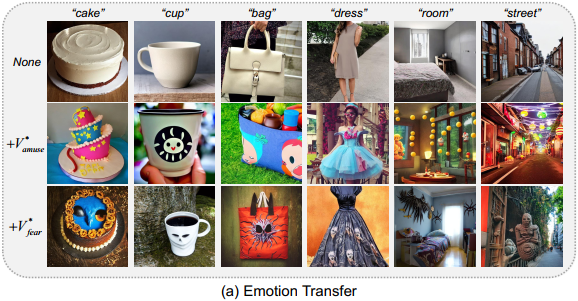

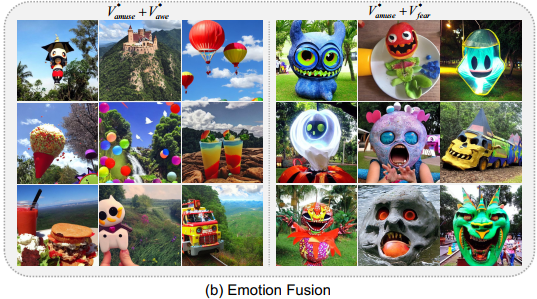

该工作首次将生成任务引入视觉情感计算领域,提出情感图像内容生成(Emotional Image Content Generation,EICG) 的概念,旨在生成语义明确、多元,并传达指定情感的图像。该工作通过建立映射网络,将情感空间与CLIP空间对齐,通过属性损失和情感置信度的设计,为抽象视觉情感提供了具体语义解释。此外,该工作针对新任务提出了三个新的评价指标;定量结果、可视化实验和用户调查验证了该工作的有效性;在情感概念分解、情感迁移和融合上的应用,展示出该工作在情感理解和情感艺术设计上的巨大潜力。

正如理查德·费曼所说:“我无法创造,就代表我没有理解”,现有视觉情感计算大多集中在识别和分类问题上,这极大地限制了该领域的发展和深入。情感图像内容生成任务的提出,一方面连接了文本和视觉模态,使自动化的情感创作成为可能;另一方面也加深了对于视觉情感的理解,拓宽了该领域的研究范畴。研究团队希望该工作的提出,可以开拓新的研究领域,启发好的研究思路,鼓励研究者们在图像情感生成、跨模态情感理解等方向不断探索。

论文信息

Jingyuan Yang, Jiawei Feng, Hui Huang*: EmoGen: Emotional Image Content Generation with Text-to-Image Diffusion Models. CVPR 2024.

END

素材来源 丨城市三维创新团队

编 辑 丨 李沛昱